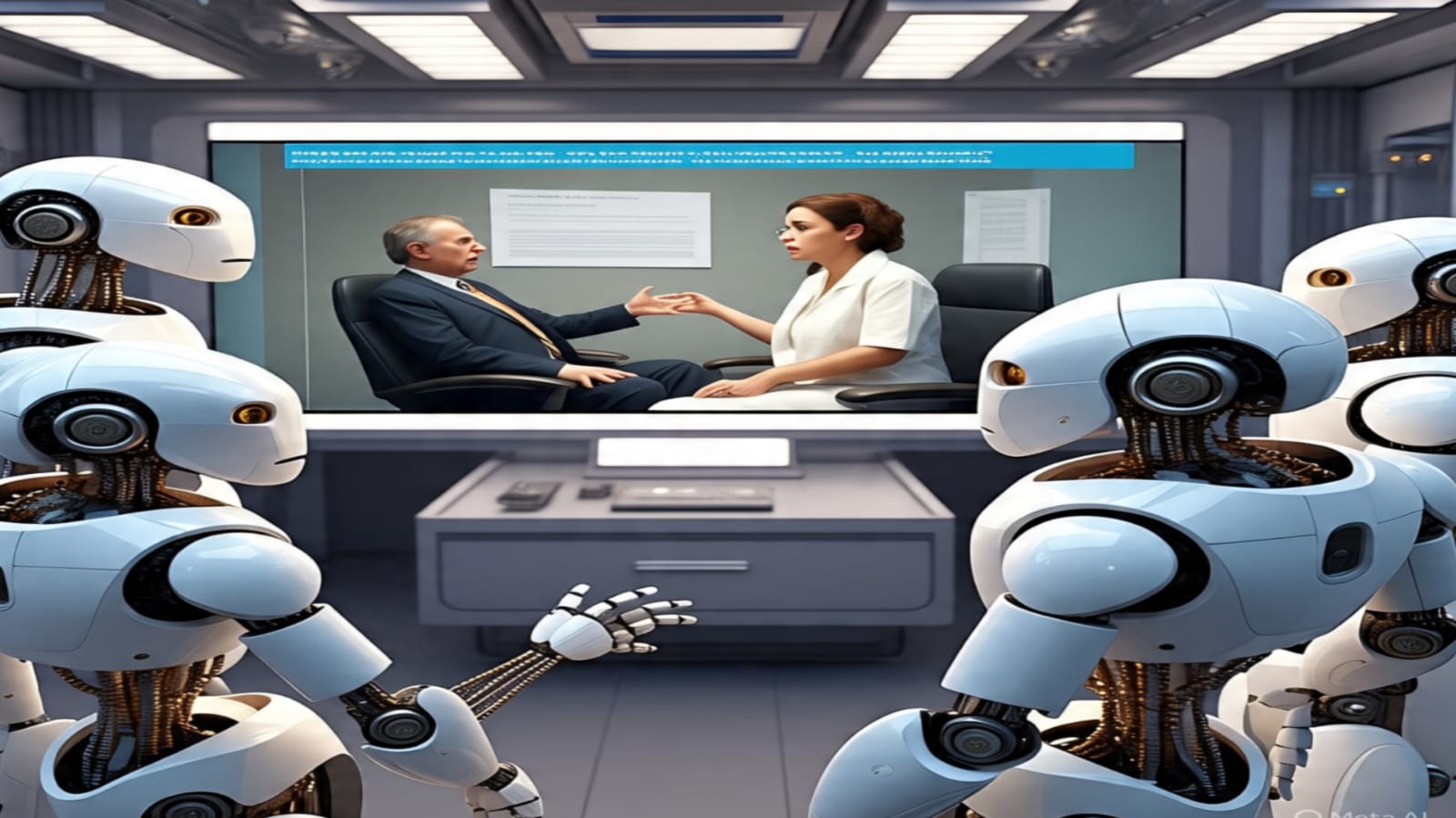

دراسة تكشف ضعف الأنظمة الذكية في تفسير الإشارات الاجتماعية

رغم التفوق الكبير لأنظمة الذكاء الاصطناعي على البشر في مجالات مثل الطب والهندسة وعلوم الفضاء وحتى الألعاب الذكية، أثبتت دراسة حديثة أن هذه الأنظمة لا تزال غير قادرة على فهم الإشارات الاجتماعية التي تحمل المعاني الضمنية لتفاعلات البشر.

تجربة جامعة جون هوبكنز تكشف الفجوة

أجرى فريق بحثي من جامعة جون هوبكنز الأميركية تجربة شارك فيها ثلاث مجموعات من المتطوعين، حيث طُلب منهم مشاهدة مقاطع فيديو لا تتجاوز مدتها 3 ثوان وتقييم طبيعة التفاعل الاجتماعي بين الأشخاص الظاهرين فيها. في الوقت نفسه، قامت أكثر من 350 منظومة ذكاء اصطناعي بتحليل المقاطع نفسها بغرض فهم مدلولات الإشارات الاجتماعية.

البشر يتفوقون بوضوح على الآلات

أظهرت النتائج أن البشر أنجزوا المهمة بسهولة وبدقة، بينما فشلت أنظمة الذكاء الاصطناعي في تفسير السياقات الاجتماعية أو فهم المغزى من تلك التفاعلات. ويرى الباحثون أن هذه الفجوة تُبرز التحدي الكبير الذي تواجهه هذه الأنظمة في التعامل مع بيئات حقيقية تتطلب فهماً دقيقاً للعلاقات الإنسانية.

تحذيرات من آثار محتملة في قطاعات حيوية

يحذر الفريق البحثي من أن عدم قدرة الذكاء الاصطناعي على قراءة الإشارات الاجتماعية قد تكون له تداعيات خطيرة في مجالات تتطلب تفاعلاً مباشراً مع البشر، مثل الروبوتات والسيارات ذاتية القيادة. وتقول الباحثة ليلى إيزيك، أستاذة العلوم المعرفية ورئيسة الفريق، إن «فهم الإنسان ومقصده وسياق التفاعل هو عنصر أساسي لأي نظام ذكي يريد التفاعل بفعالية مع البشر».

الصور الثابتة ليست كالصور المتحركة

رغم أن بعض الدراسات السابقة أظهرت قدرة أنظمة الذكاء الاصطناعي على تفسير مغزى الصور الثابتة، فإن الدراسة الجديدة سعت لاختبار الأداء مع المقاطع المصورة. وقد اختار الفريق مئات المقاطع التي تُظهر تفاعلات ثنائية، ثم اختُصرت كل مقاطع الفيديو إلى 3 ثوانٍ فقط لقياس سرعة الفهم.

اختبارات دقيقة لقياس الفهم الاجتماعي

تم طرح أسئلة متنوعة على المتطوعين مثل: «هل التفاعل في المقطع إيجابي أم سلبي؟» أو «هل يتواجه الشخصان في الفيديو؟». وتوصل المتطوعون عادة إلى إجابات متشابهة، مما يدل على وجود فهم مشترك للسياقات الاجتماعية، بينما افتقرت الأنظمة الذكية إلى هذا التوافق.

قصور في فهم الديناميكيات والعلاقات

علّقت الباحثة المشاركة كاثي جارسيا قائلة: «أنظمة الذكاء الاصطناعي لا يكفيها أن تتعرف على الأشكال أو الأشخاص، بل تحتاج إلى إدراك تسلسل الأحداث والسياق والعلاقات، وهو ما لا تستطيع فعله حتى الآن».

تحديات في الذكاء الاصطناعي المتجسد

تأتي نتائج هذه الدراسة في ظل السباق المحموم بين الشركات لتطوير ما يسمى بـ«الذكاء الاصطناعي المتجسد»، والذي يُختبر في سيارات ذاتية القيادة في مدن أميركية مثل لوس أنجليس وفينيكس. وقد أثبتت هذه السيارات قصوراً في فهم مواقف قيادة مركبة، مثل الدوران أو الرجوع للخلف.

مخاوف تتعلق بالسلامة الصناعية

شركات كبرى مثل “بوسطن ديناميكس” و”فيجر إيه آي” و”تسلا” تطور روبوتات تعمل بجانب البشر في المصانع، وهو ما يتطلب فهماً دقيقاً للإشارات الاجتماعية لتفادي الحوادث. وتؤكد إيزيك أن الدراسة تبرز أهمية دمج علوم الأعصاب والمعرفة البشرية مع تقنيات الذكاء الاصطناعي لتحقيق نتائج أفضل في الواقع العملي.